今天,我们将讨论机器学习中的一个重要方法——最大似然估计。

这是一种估计方法,允许您拟合最大利润函数模型。

01

最大似然估计法是什么

最大似然估计由高斯于1821年提出,费希尔于1912年完善。

一般来说,最大似然估计法其实来源于生活的点点滴滴。比如有一个大学生,他不天天听课,天天玩手机。老师盯着他看了半天,他也不知道怎么收敛。从老师几十年的教学经验来看,这个男生一定是期末考砸了。果然,他真的失败了。

老师是通过过去大量的类似事件来判断现在正在发生的类似事件,这叫最大似然。

其实在写这篇分享的开始,我准备了很多小故事,希望用幽默的语法,尽可能的给大家讲一个非常抽象的数学术语,让大家都能理解和接受。后来发现上面的老师和学生的例子是最合适的,因为他们这样预测过别人。

好了,故事结束了,接下来的就是主菜了。原理看起来很清楚,但实际上需要概率论的基础,利用微分来求极值。

导数

其实导数的概念挺简单的。在这里,我们不需要掌握太多关于微积分的公式,我们只需要知道如何推导。至于基本初等函数的求导,这里可以找到你需要的求导公式。

复合函数的求导满足链式法则:

,并求解x,得到的x就是驻点,驻点可以通过代入原函数得到极值。

02

求解最大似然估计量的四个步骤

最后,本文的高潮部分,如何利用最大似然估计方法找到最大似然估计量?

首先我们来看一个例子:有一个彩盒,彩盒里有很多红球和白球,除了颜色完全一样。每次我们拿出一个,录下来放回去。重复操作十次后,我们发现有七个红球和三个白球。请估计一下红球的比例。

从题目可以分析出,这个例子满足二项式分布。现在我们可以将事件A设置为“红球”,然后我们可以得到一个公式:

(1)

现在的目的是找这个P(A),那么如何快速准确的找到人才呢?如果用导数解的驻点求极值,似乎七次方不是很大,那么重复一百或一千次运算呢?所以优化算法势在必行,下面的骚操作是我们的先辈们经过不懈探索总结出来的——先取对数再求导!

取公式(1)的对数,得到:

解决它

从这个例子中我们可以得到与《概率论与数理统计》一书相匹配的抽象结果:设种群X为离散型随机变量,其概率分布为

其中θ是未知参数

和

一组样本和样本的观测值。参数θ的值应使得概率:

是θ的似然函数,上式是其样本取对应观测值的概率。同时,如果有

制作:

然后一个不知道自己是什么颜色的小家伙偷偷溜了进来

现在,黑蓝红点群展开了激烈的争论。这个小家伙属于哪一边?

但是应该怎么判断呢?

一寸想出了一个绝妙的办法,记录自己到每个色点的距离,然后选择k个距离值,画一个距离最大的圆作为半径,自己作为圆心,计算圆内每种颜色占总点数的概率。概率最大的颜色标签是一寸颜色。

当k=2时

当k=6时

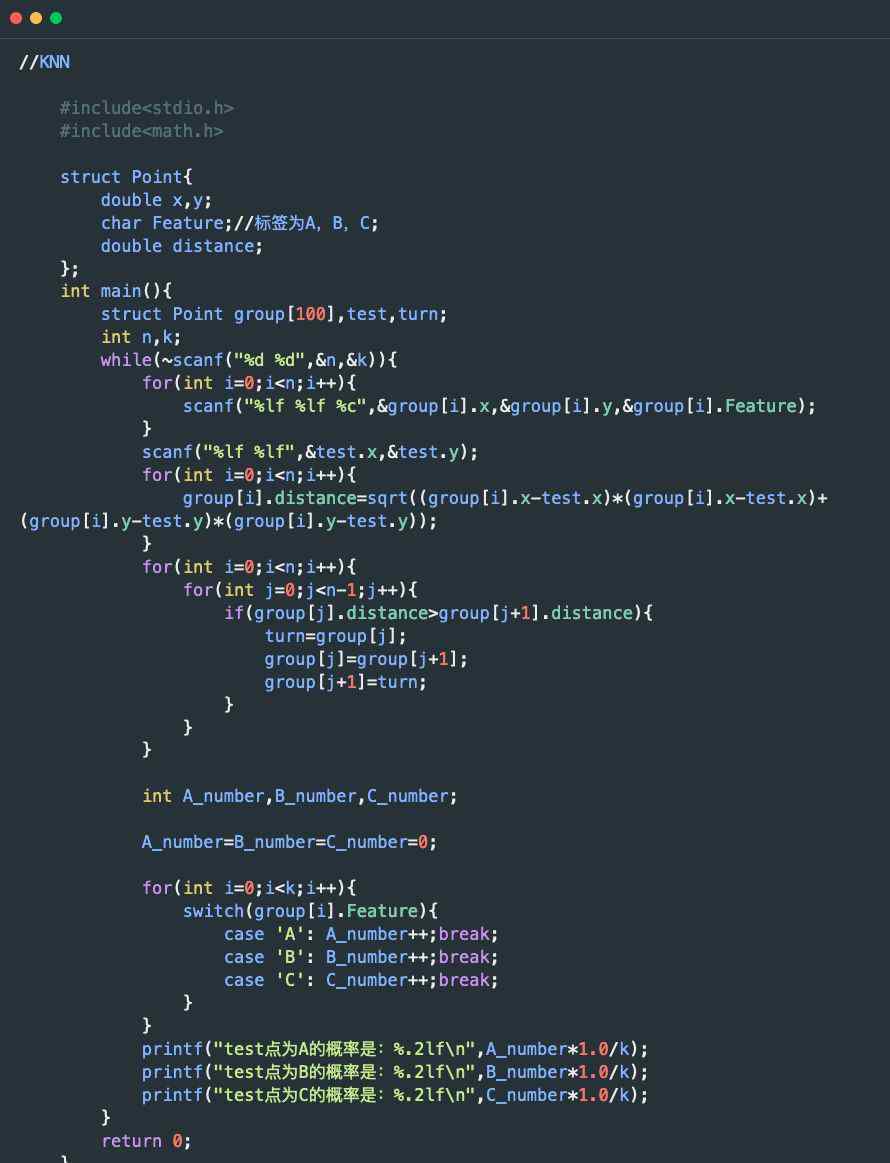

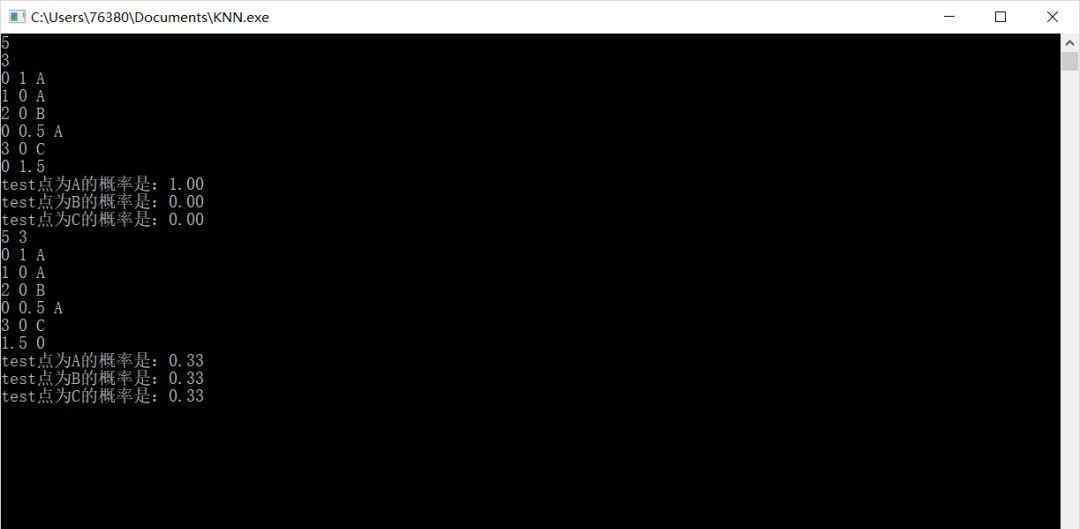

我们可以发现在有效k值内,小的那个有很大的概率是蓝色,所以我们给它一个蓝色的颜色标签。到目前为止,KNN的基本原则已经得到了澄清,所以是时候发布一个C的KNN代码了

但是还有一个问题:如何选择一个最优的k值?

这个问题将在基于K-最近邻算法的KD-树的详细讲解中进行系统阐述。目前普遍采用交叉验证或贝叶斯。先在这里挖个坑,然后慢慢填~

04

KNN算法的简单实现

测试图表如下:

KNN还有更有趣的方法,比如K-D树,分治思想下的模型,比较快。

参考文献:

概率和数理统计舒天版

维基百科最大似然估计项——维基百科不能在国内发表。有两种方法,一种是换主机,一种是你懂的。

CSDN《马克唐数学符号》——这篇文章真的是我写的,几乎被这些数学符号原地爆炸!

作者简介:

浅薄,目前就读于闽南师范大学,对国学和晨跑感兴趣,痴迷机器学习和数据挖掘,Lisp爱好者。

1.《极大似然估计 极大似然估计法的理解指南》援引自互联网,旨在传递更多网络信息知识,仅代表作者本人观点,与本网站无关,侵删请联系页脚下方联系方式。

2.《极大似然估计 极大似然估计法的理解指南》仅供读者参考,本网站未对该内容进行证实,对其原创性、真实性、完整性、及时性不作任何保证。

3.文章转载时请保留本站内容来源地址,https://www.lu-xu.com/fangchan/1285715.html