全球人工智能

文章参考:Github翻译:马卓琪

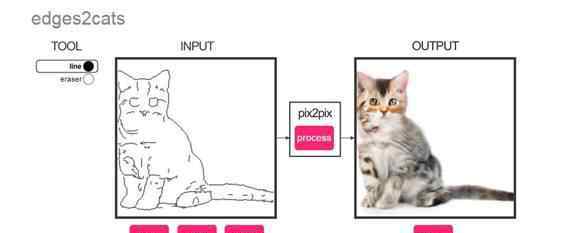

简介:最近,edges2cats的一个开源应用程序迅速流行起来。它可以自动将你鼠标画的线条图像转换成猫的图片。甚至像Yann LeCun这样的重量级人物也创造了自己的“猫电影”。

http://affinelayer.com/pixsrv/index.html

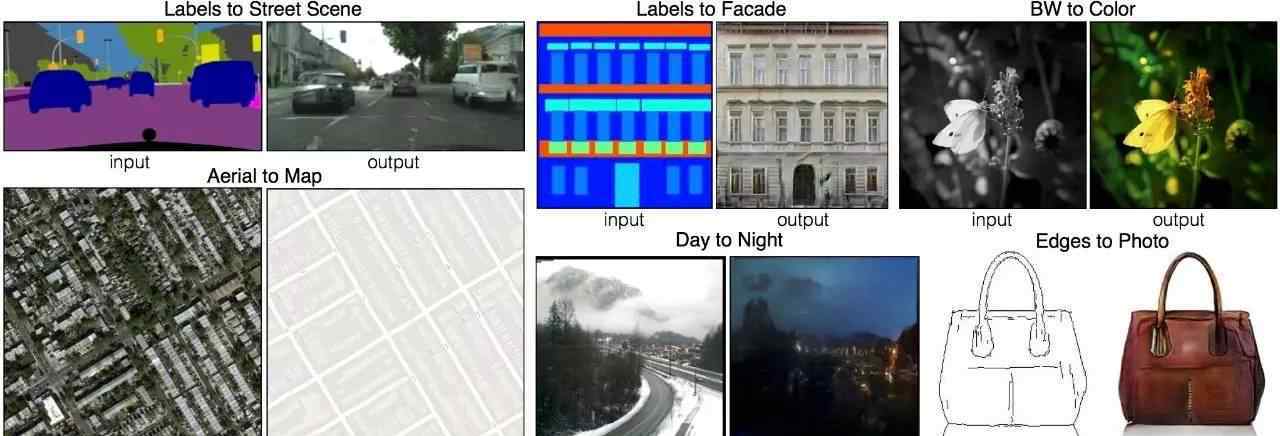

这样一种利用pix2pix将边缘图像转换成彩色图像的方法来自下面的论文。本文中,除了从边缘图像到彩色图像的转换,还有从地图到航拍图像的转换,以及从普通图像到场景图像的转换。我们来看看是怎么实现的。

Pix2pixTorch实现,学习从输入图像到输出图像的映射

论文:“利用条件对抗网络将图像转化为图像”

在一些任务中,我们可以在小数据集上获得快速而良好的结果。比如学习生成一个建筑的立面图(上图),我们只需要在400张图像上训练两个小时(硬件配置是单个Pascal Titan X GPU)。但是对于更难的问题,需要在更大的数据集上训练几个小时甚至几天。

设置环境需要Linux或OSX系统

NVIDIAGPU+CUDA CuDNN(CPU模式和没有CuDNN加速的CUDA可能会在做了一些改动后运行,但是没有经过测试)

初始阶段

安装torch及其依赖项。

地址:https://github.com/torch/distro

安装火炬的图形和显示模块

luarocks安装nngraph

luarocks安装

地址:https://raw . githubusercontent . com/szym/display/master/display-SCM-0 . rock spec。

复制回购

git clone git @ github . com:phillipi/pix 2 pix . git CD pix 2 pix

下载数据库(以CMP大楼前台数据库为例)

巴什。/dataset/download _ dataset . sh facades

培训模式

DATA_ROOT=。/dataset/facadesname = facades _ generation what _ direction = BtoA th train . Lua

th-LD display . start 8000 0 . 0 . 0 . 0

最后,测试模型:

DATA_ROOT=。/dataset/facadesname = facades _ generation what _ direction = BtoA phase = val th test . Lua

测试结果存储在一个html文件中:

。/results/facades _ generation/latest _ net _ G _ val/index . html。

火车

DATA _ ROOT =/path/to/DATA/name = ex pt _ name what _ direction = ATob th train . Lua

用BtoA代替AtoB,训练图像反方向转换

模型存储在。/checkpoints/expt_name(可以通过在train.lua中修改checkpoint_dir=your_dir来更改存储路径)

有关更多培训选项,请参考选择参加培训

测试

DATA _ ROOT =/path/to/DATA/name = ex pt _ name what _ direction = ATob phase = val th test . Lua

该命令以AtoB的方向运行expt_name模型,并测试/path/to/data/val的所有图像

转换后的图像结果和可以看到结果的网页存储在。/results/expt_name(可以通过在test.lua中更改参数results_dir=your_dir来更改存储路径)

更多测试选项,请参考选择测试

数据库

巴什。/dataset/download _ dataset . sh dataset _ name

使用以下程序下载数据:

正面:400张来自化学机械抛光正面数据库的图片

城市风景:来自城市风景训练集的2975张图片

地图:来自谷歌地图的1096张图片

Edges2shoes: 50k训练图来自UT Zappos50K数据集。通过HED边缘检测和后处理计算得到边缘图。

edge S2手袋:亚马逊手袋的137k照片,来自iGAN项目。通过HED边缘检测和后处理计算得到边缘图。

模型使用以下命令下载预先训练好的模型。下载后需要对模型进行重命名。(例如,facades_label2image更改为/check points/facades/latest _ net _ g . T7)

巴什。/models/download _ model . sh model _ name

Facades_label2image(将类别标签转换为建筑立面):在CMPFacades数据库上进行培训。

Cityscapes _ label2image(将类别标签转换为街道视图):在citycaps数据库上训练。

Cityscapes_image2label:在citycaps数据库上训练。

地图2卫星(地图到航空照片):谷歌地图数据库培训。

Sat2map(将航空照片转换成地图):在谷歌地图数据库上的培训。

edge 2s hoes:utzappos 50k数据库培训。

edges 2手袋:亚马逊网站图像数据库培训。

第二天晚上:训练大约100张网络摄像机的图片

http://transattr.cs.brown.edu/.

准备训练和测试数据 生成图像对 我们提供了一个python程序来生成图像对{A,B}形式的训练数据,其中A和B是同一基础场景的两种不同表示。比如说,可以是{类标图,照片},或者{二值图像,彩色图像}。然后我们就可以学习将A转换到B,或者将B转换到A:创建文件夹/路径/目标/数据和子文件夹A和b。A和b应该有自己的子文件夹,用于存储不同用途的数据,如培训、val、测试等。

In /path/to/data/A/train,放A风格的训练图。

In /path/to/data/B/train,放上风格B的对应图片。

对其他数据分区(验证数据、测试数据等)也要这样做。)

图像对{a,b}的对应图像应具有相同的大小和文件名,例如/path/to/data/A/train/1.jpg的对应图像应为/path/to/data/b/train/1.jpg。

当数据被处理成这样的格式时,调用:

python s/combine _ A _ and _ B . py-fold _ A/path/to/data/A-fold _ B/path/to/data/B-fold _ AB/path/to/data

这将把每个图像对组合成一个单独的图像文件,为训练做好准备。

上色任务注意事项如果要上色,不需要运行combine _ a _ and _ b.py,只需要准备一些自然的图像,然后在程序中设置参数preparation =上色即可。程序会自动将每个RGB图像转换成Lab color 空,然后创建L->: Ab图像对。

边缘提取我们提供python和Matlab程序从照片中粗略提取边缘。运行s/edges/batch_HED.py计算HED边。运行s/edges/后处理m,通过后处理步骤简化边缘。有关更多详细信息,请参见代码文档。

显示界面选项,培训和测试时显示图片,使用显示包。

安装:luarocksinstall

https://raw . githubusercontent . com/szym/display/master/display-SCM-0 . rock spec

启动服务器:th-LD display . start

在浏览器中打开网址:http://localhost: 8000

默认情况下,服务器监听本地主机。输入0.0.0.0以允许任何接口的终端连接

th-LD display . start 8000 0 . 0 . 0 . 0

然后在浏览器中打开http://(主机名):(端口)/下载远程桌面

默认情况下,显示L1误差曲线。将环境变量display_plot的值设置为逗号分隔的列表

ErrL1、errG和errD可以分别显示L1、发生器和鉴别器的误差。比如只想在显示界面画出发生器和鉴别器的误差,而不是默认的L1误差,设置display_plot="errG,errD "。

引用如果你在你的研究中使用我们的代码。

请引用我们的论文“使用条件对抗网络的图像到图像转换”https://arxiv.org/pdf/1611.07004v1.pdf

@article{pix2pix2016,

title = {带有条件状语网络的图像到图像翻译},

作者={Isola,Phillip and Zhu,Jun-Yan and Zhou,Tinghui andEfros,Alexei A},

日志={arxiv},

年份={2016}

}

猫散文如果你爱猫,喜欢看关于形象、视觉、学习的论文,可以看看这篇猫散文

谢谢你。大多数代码引用自DCGAN。数据下载器由DCGAN和上下文编码器修改。

原文:使用条件高级网的图像到图像翻译

热门文章推荐

1.《卓奇网络 开源|分分钟教你学会:使用条件对抗式网络进行图像转换》援引自互联网,旨在传递更多网络信息知识,仅代表作者本人观点,与本网站无关,侵删请联系页脚下方联系方式。

2.《卓奇网络 开源|分分钟教你学会:使用条件对抗式网络进行图像转换》仅供读者参考,本网站未对该内容进行证实,对其原创性、真实性、完整性、及时性不作任何保证。

3.文章转载时请保留本站内容来源地址,https://www.lu-xu.com/junshi/833090.html