PaperWeekly原作者|黄朴

学校|华中科技大学硕士

研究方向|多目标跟踪

近年来,随着tracker ++等集成检测和多目标跟踪算法框架的出现,出现了很多相关的多目标跟踪算法变体,基本上排在了MOT Challenge榜单的前列,包括新开放的top CenterTrack。在这里,我将分析集成检测和跟踪的框架。MOT和数据关联的基础知识可以在我的专栏里查看。后面我还会专门介绍基于深度学习的数据关联,ReID2MOT和SOT2MOT。

D&。T

其中s是衡量不同任务下个人损失的不确定因素。详细原理请参考CVPR 2018《利用不确定性对场景几何和语义损失进行加权的多任务学习》关于方差不确定性对多任务权重影响的分析。

效果和速度都很吸引人~

受精卵输卵管移植

论文题目:在线多目标跟踪的运动和外观改进

作者:姚黄,寿韩栋,赵骏,东海刘胜,王宏伟,恩宇,和郭志忠

备注:MOT 15 ~ 17: 60.1,60.4,48.1 MOTA(公众)

论文链接:https://arxiv.org/abs/2003.07177

代码链接:https://github.com/nightmaredimple/libmot

这也是我们团队基于tracker ++框架做的一个框架,主要是对运动模型、表观模型、数据关联的改进。由于一些原因,这里就不细说了。代码会慢慢开源,但暂时不会完全开源。

对于运动模型部分,我们将卡尔曼和椭圆曲线模型集成在一起,而不是单独执行。实验表明,集成版本比单独版本高1.4 MOTA。

对于视在模型,我们考虑了特征对齐的因素,做了一点改进,设计了一个结合可见性预测的多任务视在模型:

在比较观测帧和跟踪轨迹的特征时,考虑跟踪轨迹的历史信息进行自适应加权:

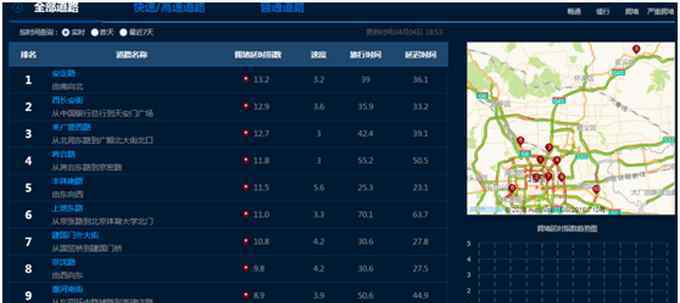

通过以上分析可知,数据关联部分的特征相似度计算不仅需要n:m(对于马氏距离)的卡尔曼更新过程,还需要m:(nxk)的表观特征比较,耗时。因此,我们使用三维积分图像快速分配空之间的区域,将特征相似度计算的复杂度降低到O(m+n)。

该方法非常巧妙,即使用一热编码将每个观察帧映射到特征图,比基于iou的方法快得多:

后来我做了一些实验,结果比论文里的要好。MOT15~17: 48.1,60.4,60.1 MOTA(公众)。

中央跟踪

将对象跟踪为点

作者:邢一周(centernet的作者)、弗拉德伦·科尔敦和菲利普·克亨布尔

注:同时实现2D/3D多目标跟踪,包括人和车,MOT 17: 61.4(公共),67.3(私人)MOTA,22FPS!!!

基迪:89.4公吨

论文链接:http://arxiv.org/abs/2004.01177

代码链接:https://github.com/xingyizhou/CenterTrack

中心跟踪(CenterTrack)是CenteNet作者基于Tracker ++的多目标跟踪框架,它是通过用中心网代替更快的RCNN来实现的,因此跟踪框架成为跟踪中心。

通过上图,可以大致分析算法框架。除了使用中心网检测两个相邻的帧之外,我们还使用D & amp;T帧策略,预测同时存在于两个帧中的目标的相对位移,从而进行跟踪和预测。

对于提供的观察帧,作者将这些观察帧的中心点映射到单通道热图,然后通过高斯模糊考虑这些点的附近。

因此,CenterTrack和CenterNet的区别在于,输入维度增加(两张3d图像和一张观察位置热图),输出成为两张图像的目标中心位置、大小和相对偏移量。

对于测试环节的数据关联部分,作者直接通过中心点的距离来判断是否匹配是一种贪婪的方式,而不是匈牙利算法的全局数据关联优化。在训练过程中,作者不仅使用相邻帧进行训练,还允许使用三帧。

“中央追踪”在2D/3D多行人/车辆追踪任务中,在MOT、KITTI和nuScenes数据集上取得了SOTA成果。

引用

[1] Feichtenhofer C,Pinz A,Zisserman A. Detect to track,track to detect[C]。摘自:美国电气和电子工程师协会国际计算机视觉会议录。2017.3038-3046.

[2]陈力,艾赫,庄z,等.深度学习的实时多人跟踪候选人选择和人物再识别[C]。in: 2018 IEEE国际多媒体会议暨博览会(ICME)。IEEE,2018。1-6.

[3]博格曼·P,梅哈特·T,利尔-泰西·l .不带铃铛和哨子的追踪[C]。摘自:美国电气和电子工程师协会国际计算机视觉会议录。2019.941-951.

[4]通过流动和融合进行多目标跟踪

[5]走向实时多目标跟踪

[6]在线多目标跟踪的运动和外观改进

[7]跟踪对象作为点

#提交渠道#

让你的论文被更多人看到

怎样才能让更多高质量的内容以更短的方式到达读者手中,缩短读者寻找高质量内容的成本?答案是:你不认识的人。

总有你不认识的人知道你想知道的。PaperWeekly可能会成为一座桥梁,促使来自不同背景和方向的学者和学术灵感相互碰撞,从而在生成中创造更多的可能性。

PaperWeekly鼓励大学实验室或个人在我们的平台上分享各种高质量的内容,可以是最新的论文解读、学习经验或技术干货。我们只有一个目的,这样知识才能真正流动。

贡献标准:

稿件确实是个人原创作品,稿件中要注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

如果文章不是第一篇,请在提交文章时提醒并附上所有已发布的链接

《纸周刊》默认每篇都是第一篇,会加“原创”logo

提交电子邮件:

提交邮件:hr@paperweekly.site

所有文章均附有图片,请在附件中单独发送

请留下您的即时联系方式(微信或手机),以便我们在编辑和发布时与作者沟通

1.《17tracking 联合检测和跟踪的MOT算法解析(含MOT17 No.1等多个榜前算法)》援引自互联网,旨在传递更多网络信息知识,仅代表作者本人观点,与本网站无关,侵删请联系页脚下方联系方式。

2.《17tracking 联合检测和跟踪的MOT算法解析(含MOT17 No.1等多个榜前算法)》仅供读者参考,本网站未对该内容进行证实,对其原创性、真实性、完整性、及时性不作任何保证。

3.文章转载时请保留本站内容来源地址,https://www.lu-xu.com/jiaoyu/753777.html